Implicaciones éticas del uso de TIC e IA en estudios de salud: reflexiones y recomendaciones

Como parte del ciclo de videoconferencias de la Escuela de Salud Pública de México (ESPM), el martes 12 de junio de 2024, las maestras Laura Chavira Razo y Zafiro Andrade Romo presentaron la conferencia titulada “Consideraciones éticas en estudios con uso de Tecnologías de Información y Comunicación (TIC) y la Inteligencia Artificial”. En ella, enfatizaron que, dado que existen múltiples realidades, cualquier revisión sobre el uso de tecnologías en el área de la salud debe hacerse desde un punto de vista crítico para poder reconocer las implicaciones éticas que el uso de la inteligencia artificial (IA) tiene en la investigación.

Como parte del ciclo de videoconferencias de la Escuela de Salud Pública de México (ESPM), el martes 12 de junio de 2024, las maestras Laura Chavira Razo y Zafiro Andrade Romo presentaron la conferencia titulada “Consideraciones éticas en estudios con uso de Tecnologías de Información y Comunicación (TIC) y la Inteligencia Artificial”. En ella, enfatizaron que, dado que existen múltiples realidades, cualquier revisión sobre el uso de tecnologías en el área de la salud debe hacerse desde un punto de vista crítico para poder reconocer las implicaciones éticas que el uso de la inteligencia artificial (IA) tiene en la investigación.

La maestra Laura Chavira definió la inteligencia artificial (IA) como sistemas informáticos capaces de realizar tareas que usualmente requieren inteligencia humana, como resolver problemas, reconocer patrones o tomar decisiones. Indicó que, en los últimos 26 años, las áreas de comprensión de lectura, comprensión del idioma y reconocimiento de imágenes han experimentado un notable progreso en IA, al punto que algunos algoritmos han superado el desempeño humano. En los últimos 4 o 5 años, el desarrollo de la IA ha crecido exponencialmente, duplicándose casi la cantidad de artículos relacionados con IA desde el 2020.

La investigadora destacó que la mayor brecha en el desarrollo de la IA son los marcos éticos y regulatorios para su uso, no solo en la investigación, sino en otras áreas de la salud. Aunque existen principios éticos establecidos que pueden resolver algunos dilemas actuales, su aplicación es insuficiente. Recién en enero de este año, la Organización Mundial de la Salud (OMS) publicó guías para modelos multimodales largos que usan textos e imágenes, y en mayo, la Unión Europea (UE) desarrolló un marco común para el uso de la IA e instaló una oficina permanente.

La Mtra. Chavira señaló la falta de lineamientos para autores de revistas especializadas que utilizan IA para escribir textos e incluir imágenes. Entre las buenas prácticas, estas revistas proponen prohibir citar herramientas de IA como autores y hacer explícito su uso en revisiones, síntesis o traducciones. Indicó que la ausencia de guías éticas no justifica el uso de estas herramientas sin considerar principios éticos.

Algunos productos de análisis cualitativo, como MAXQDA, utilizan IA para sintetizar grandes cantidades de texto. En la investigación, se crean algoritmos para inferencias, predicciones, conclusiones, recomendaciones y toma de decisiones. Es crucial, dijo la especialista, cuestionar el sesgo de las fuentes de datos y si el algoritmo está replicando prejuicios sociales. Así que hizo las siguientes recomendaciones para el uso de la IA en investigación:

- Tener curiosidad: buscar problemas para resolver, entendiendo las fortalezas y limitaciones de las herramientas de IA.

- Tener una visión crítica: revisar la replicación de sesgos e inequidades, la veracidad, evitar plagio y cuidar la confidencialidad de la información.

- Tomar acción: seguir prácticas de transparencia y reproducibilidad, adherirse a principios éticos de justicia y respeto por las personas, redactar lineamientos y seguir ciclos de mejora.

Recomendó además hacer preguntas como a quién se está excluyendo, qué prejuicios sociales están replicando los modelos, así como cuáles son las limitaciones de los datos utilizados y del software para sintetizar datos.

Recomendó además hacer preguntas como a quién se está excluyendo, qué prejuicios sociales están replicando los modelos, así como cuáles son las limitaciones de los datos utilizados y del software para sintetizar datos.

Por su parte, la Mtra. Zafiro Andrade definió las TIC como herramientas y equipos para comunicarse, interactuar, almacenar y procesar datos, y crear nuevos productos y servicios, como teléfonos inteligentes, internet y plataformas de comunicación como Facebook o WhatsApp. Mostró tres ejemplos de estudios con uso de TIC y sus consideraciones éticas:

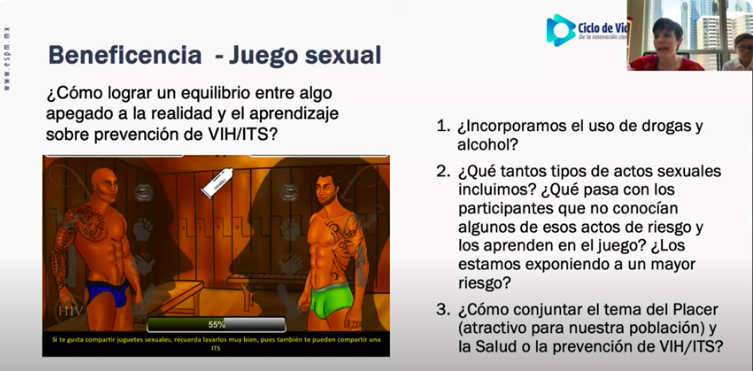

- Estudio para desarrollar una intervención de gamificación para incentivar el aprendizaje sobre VIH/Sida e ITS y la realización de pruebas de VIH y Sí

- FUERTES: formando un hábito juntos, para mejorar la adherencia al terapia antirretroviral (TAR) en hombres de la diversidad sexual que viven con VIH, mediante intervenciones enfocadas en la formación de hábitos y bienestar mental.

- Proyecto DaRe: para explorar el rol de la autonomía en el bienestar mental de mujeres adultas lesbianas, gays, bisexuales, transgénero y queer (LGBTQ+) en México.

Como consideraciones éticas, recomendó obtener el consentimiento informado, resguardar la confidencialidad, prever las implicaciones del uso de WhatsApp o Zoom, y resguardar adecuadamente material sensible y registros de foto y video.

A manera de reflexiones finales, la Mtra. Andrade destacó la importancia de una buena planeación del estudio y la creación de un protocolo que visualice las diferentes etapas y potenciales problemas éticos. Asimismo, sugirió incluir a la población durante el diseño del estudio para evaluar riesgos, realizar pilotajes, mantener comunicación constante con la comisión de ética y volver siempre a los principios éticos para guiar las decisiones.

Para conocer a detalle lo expuesto en esta videoconferencia, consulta la grabación en nuestro canal de Youtube: